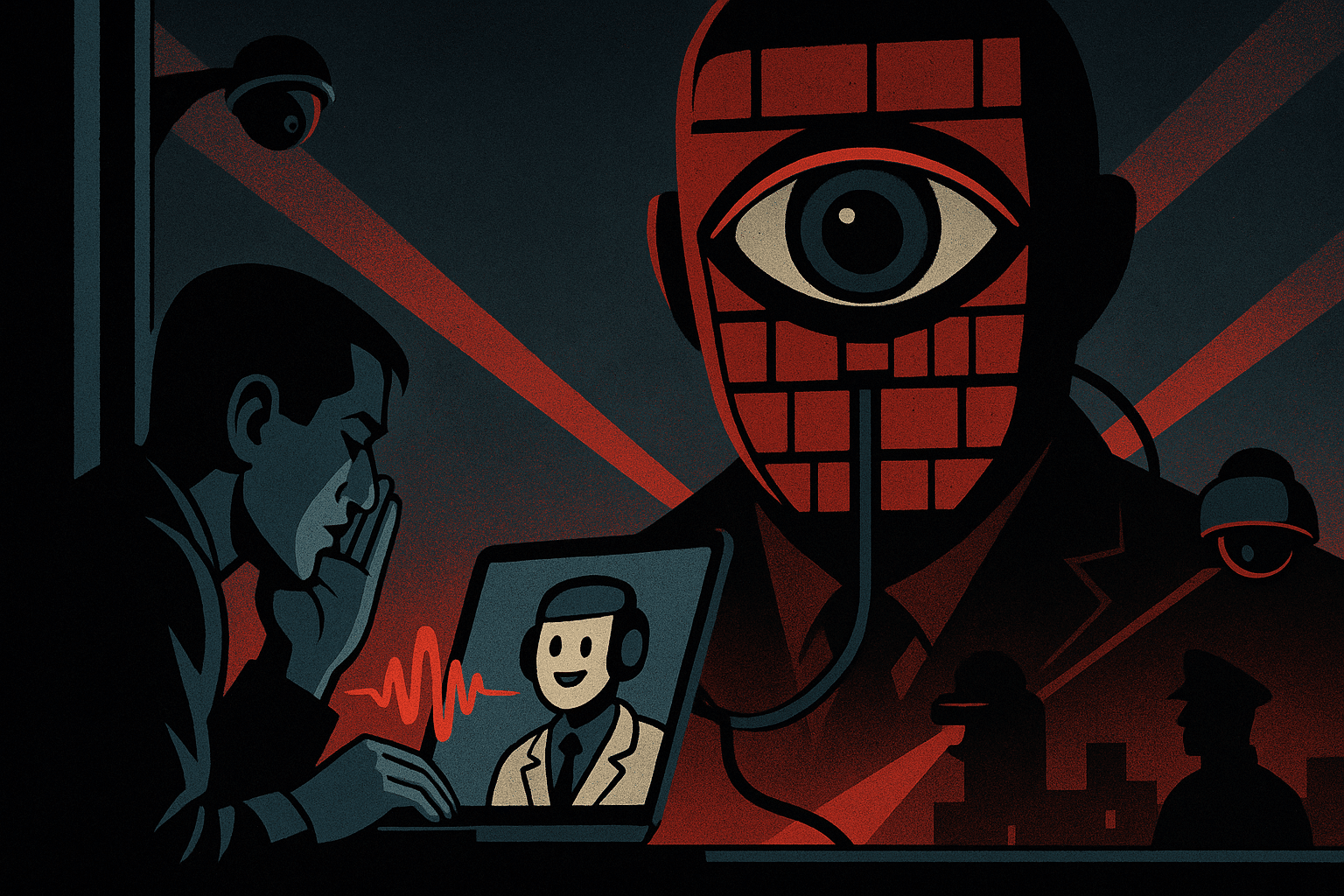

Spoločnosť OpenAI oficiálne potvrdila, že analyzuje konverzácie používateľov v rámci služby ChatGPT s cieľom identifikovať potenciálne hrozby. Podľa zverejnených informácií sú interakcie, ktoré naznačujú plánovanie ublíženia iným osobám, postúpené špecializovanému tímu na manuálne posúdenie. V prípade, že ľudský kontrolór vyhodnotí situáciu ako bezprostrednú hrozbu vážneho fyzického ublíženia, spoločnosť môže túto skutočnosť nahlásiť orgánom činným v trestnom konaní.

Tento postup vyvolal rozsiahlu diskusiu o ochrane súkromia a miere dohľadu nad používateľmi. Kritici poukazujú na riziko narušenia dôvernosti, čo predstavuje problém najmä pre profesie ako právnici, a vyjadrujú obavy z eskalácie situácií, ktoré môžu mať pozadie v duševných problémoch. Spoločnosť OpenAI sa tak nachádza v zložitej pozícii, kde balansuje medzi požiadavkami na bezpečnosť platformy a ochranou súkromia používateľov, čo reflektuje širšie výzvy, ktorým čelí celý sektor umelej inteligencie.